Du nouveau dans les puces d'Alexa

Jeudi, Amazon a indiqué sur le blog dédié à AWS un changement concernant Alexa. L'assistant vocal du groupe bénéficie dorénavant de puces maison.

Publié le 13-11-2020 par Alexandra Nuiry

Après Apple, voilà qu' Amazon revendique lui aussi l'usage de composants créés en interne. Selon l'article de Seb Stomarcq, 'une majorité' des puces dédiées au traitement des données envoyées par les utilisateurs via Alexa sont dorénavant des Inferentia, développées par Amazon depuis 2018.

Il s'agit d'un changement technique en arrière-plan, et non dans les appareils, qui représente un gain de 25 % en termes de latence et de 30 % en termes de coût par rapport au matériel Nvidia utilisé jusqu'alors. Il devient donc possible pour les développeurs de traiter les données plus précisément sans pourtant allonger le temps nécessaire à l'analyse de la requête.

Un gain de temps et d'argent

Avec son Inferentia, premier silicium maison du groupe, Amazon souhaite accélérer le traitement des tâches de machine learning dont le volume est conséquent. La pièce a été conçue pour offrir des performances d'inférence élevées dans le cloud, sur lequel s'appuie Alexa. Son potentiel s'élève ainsi à 128 téra-opérations par seconde. L'Inferentia a également l'avantage de réduire les coûts en supprimant un intermédiaire. Quant au design de la pièce, il a été assuré par Anapurna Labs, une structure rachetée par Amazon en 2015.

Outre Alexa, Seb Stomarcq a précisé que Rekognition, le système de reconnaissance faciale s'appuyant sur le cloud, allait être lui aussi doté du silicium du groupe. Dans son article, il cite quelques clients extérieurs ayant recours à l'Inferentia. Parmi eux, Snap Inc. pour son application Snapchat ou encore le groupe Condé Nast. Elle est également utilisée par l'assureur Anthem. Amazon en offre ainsi l'utilisation à ses clients AWS gratuitement.

Les dernières actualités

Publié le 07/05/2024 à 10:42:13

Travail : au premier trimestre, l'emploi salarié privé a progressé en France

Publié le 07/05/2024 à 10:42:13

Pékin autorise les Français à voyager en Chine sans visa, jusqu'en 2025

Publié le 07/05/2024 à 10:42:09

Immobilier : pénalisé par le prix élevé des biens, le montant des nouveaux crédits chute à nouveau

Publié le 07/05/2024 à 10:42:08

🔴 Suivez en vidéo l'édition 2024 du « Forum Europe-Afrique »

Publié le 07/05/2024 à 10:42:04

Automobile : « l'industrie automobile chinoise est la bienvenue en France », selon Bruno Le Maire

Publié le 07/05/2024 à 10:42:03

Soulagement pour le cognac et l'armagnac : Xi Jinping prêt à lever les sanctions

Publié le 07/05/2024 à 10:42:03

Bataille des tours télécoms: Bénonces, ce village de l'Ain qui a failli perdre sa couverture mobile

Publié le 07/05/2024 à 10:42:03

Tensions commerciales : le difficile numéro d'équilibriste de Le Maire face à la Chine

Publié le 07/05/2024 à 10:42:02

Pour accueillir la flamme olympique, Marseille voit grand

Publié le 07/05/2024 à 10:41:54

Airbnb : « 60% des Français louent leur logement pour boucler leur fin de mois » (Clément Eulry)

Publié le 06/05/2024 à 10:42:07

Spatial : le vaisseau de Boeing, Starliner, doit décoller avec des astronautes à son bord pour la première fois

Publié le 06/05/2024 à 10:42:07

Plan Ecophyto: la nouvelle stratégie du gouvernement pour réduire les pesticides présentée ce lundi

Publié le 06/05/2024 à 10:42:03

Vinci: le patron de la branche Construction en pôle position pour succéder au PDG Xavier Huillard

Publié le 06/05/2024 à 10:42:02

Les 5 infos business à retenir ce lundi matin (Atos, voitures électriques, Xi Jinping, Vueling, emploi américain)

Publié le 06/05/2024 à 10:42:02

La dernière bataille d'Atos commence entre Layani, Kretinsky et les créanciers

Publié le 06/05/2024 à 10:41:58

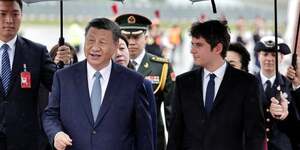

Guerre et commerce au menu de la visite de Xi Jinping en France

Publié le 06/05/2024 à 10:41:53

Les Régions françaises et la SNCF : le « Je t’aime moi non plus » permanent

Publié le 06/05/2024 à 10:41:51

Automobile : le gouvernement veut multiplier par quatre les ventes de voitures électriques d'ici à 2027

Publié le 05/05/2024 à 10:42:06

Xi Jinping en France : une visite fort opportune

Publié le 05/05/2024 à 10:42:05

EXCLUSIF - Emmanuel Macron : « Je m’impliquerai dans les européennes »